Das sind zwei Ausschnitte eines Beitrags der Tagesschau vom 14.03.2026:

Entscheidend ist der hier grau markierte Satz:

Zunächst muss festgestellt werden, dass unter dem von der Tagesschau angegebenen Link nur eine einzige Studie zu finden ist und keine Studien. Da könnte sich die Redaktion des NDR noch ungelenk darauf hinausreden, dass in der verlinkten Studie ja auch andere Studien zitiert werden würden.

Entscheidend ist aber: Dass „Frauen in der Politik besonders häufig Ziel solcher Angriffe werden“, wie die Tagesschau behauptet, steht in der 35-seitigen Studie an keiner Stelle.

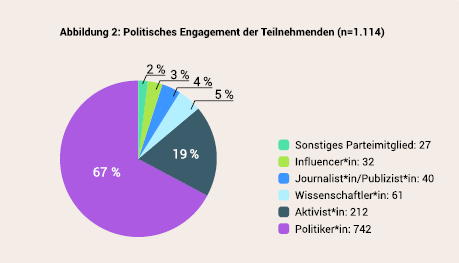

In der Studie von HateAid und der TU München* wurden nämlich nicht nur Politiker(innen) befragt, sondern auch andere im Bereich der öffentlichen Meinung tätige Personen:

Die Darstellung der von „digitaler Gewalt“ Betroffenen erfolgte dann aber nicht nach der Geschlechterverteilung innerhalb der Untergruppe der „Politiker*innen“ (und das wäre die entscheidende Zahl gewesen!), sondern nur nach den Berufsfeldern, also Politiker, Journalisten, Aktivisten, Influencer und Wissenschaftler:

Die Studienergebnisse beantworten somit an keiner Stelle, ob weibliche Politiker häufiger als männliche Politiker von „digitaler Gewalt“ betroffen sind. In Bezug auf die Verteilung nach abgefragten Berufen sieht es so aus, als wäre die Politik gar nicht die Nummer eins (allerdings eben bezogen auf beide Geschlechter).

Und in der Studie steht an zwei Stellen expressis verbis: „Die Ergebnisse sind nicht repräsentativ.“ Es handelte sich wohl um eine selbstselektierte Stichprobe. Das kann man machen, darf aber keinesfalls für politische Entscheidungen herangezogen werden, da hier oft nur eine ingroup gemessen wird. Die Studie listet aber weitreichende politische Implikationen auf (siehe hier im Beitrag unten).

Um die Aussage, dass Frauen in der Politik besonders häufig das Ziel von „digitaler Gewalt“ wären (im Vergleich zu Männern in der Politik und/oder zu anderen Berufssparten), belastbar zu beweisen (oder eben nicht), hätte man methodisch völlig anders vorgehen müssen.

Im Anhang ist nicht, wie allgemein gefordert, der Fragebogen abgedruckt. Wir wissen also nicht, wie HateAid überhaupt „digitale Gewalt“ abgefragt hat. Wir wissen aber, dass schon eine einzige Erfahrung digitaler Gewalt ausreichte (S. 17). Dies verwundert, denn beleidigt wurde im Netz doch jeder schon einmal, der öffentlich aktiv ist, also müssten 100 Prozent betroffen sein.

Schwerwiegende Methodenkritik auch am Studiendesign von HateAid

Hier ist also nicht nur die Tagesschau, sondern auch HateAid deutlich in die Verantwortung zu nehmen: Das ist keine Studie, die den Regeln empirischer Sozialforschung entspricht, wie sie im Klassiker Atteslander stehen und wie ich sie noch gelernt habe. Wenn etwa im Rahmen der qualitativen Erhebung parallel zur Fragebogenerhebung überhaupt nur noch zwölf Frauen interviewt wurden, so liegt ein Methodenfehler vor: Das Ergebnis, dass Frauen stärker von „digitaler Gewalt“ betroffen seien als Männer, muss im vorhinein schon festgestanden haben. Andernfalls hätte man die qualitative Untersuchung doch nach der quantitativen ergebnisoffen machen müssen (noch einmal: so habe ich es gelernt und so steht es auch in jedem Lehrbuch).

HateAid gibt aber folgende Zahlen an:

- Die quantitative Datenerhebung (Befragung von 1.114 Personen, nicht repräsentativ) wurde von 27.04. bis 21.10.2024 durchgeführt.

- Die qualitative Datenerhebung (die zwölf Interviews mit Frauen) wurde von 02.07. bis 26.08.2024 durchgeführt.

Die Interviews mit den zwölf Frauen wurden also allesamt bereits geführt, als die Fragebogenerhebung noch im Gang war. Dies beweist, dass der Fokus auf Frauen bereits im vorhinein festgestanden haben muss.

Daraus folgt aber, dass eine Studie, die den Fokus auf Frauen legt, natürlich misst, dass Frauen häufiger betroffen sind. Erneut ein schwerer Methodenfehler, ein Verstoß gegen das Gütekriterium der Validität.

Spätestens hier hätte man übrigens die Studie abbrechen müssen, da klar geworden sein müsste, dass mehrheitlich linksgrünes Klientel befragt wurde:

Die Studie sagt somit, man muss das klar und deutlich aussprechen, nichts aus.

Und jetzt lesen Sie die – die Meinungsfreiheit radikal einschränkenden – Forderungen, die aus den nicht validen Zahlen von HateAid abgeleitet wurden:

Sollten weitere Studien von HateAid ähnlich gestrickt sein, muss die gesamte Forschung und muss das gesamte politische Narrativ dieser Organisation von Grund auf hinterfragt werden.

Meine Hypothese lautet, dass wir es hier mit einer neuen Form von linksgrüner aktivistischer Wissenschaft zu tun haben, die nicht mehr ergebnisoffen arbeitet, sondern nur noch erwünschte Zahlen konstruiert. Das wäre fatal für die Wissenschaft, wenn es stimmt. Kurioserweise würde dies tatsächlich die Demokratie zerstören – von jenen, die sie vorgeblich retten wollen.

Denn aus nicht-validen Zahlen kann keine valide Politik abgeleitet werden.

* HateAid, Koch, L., Voggenreiter, A., Steinert, J. I. (2025): Angegriffen & alleingelassen. Wie sich digitale Gewalt auf politisches Engagement auswirkt. Ein Lagebild. 35 Seiten.

Dieser Blogbeitrag von Dr. Stefan Weber stellt im Kern eine klassische methodenkritische Intervention dar. Er richtet sich nicht gegen das Thema „digitale Gewalt“ als solches, sondern gegen eine wissenschaftliche Praxis, die man in den letzten Jahren leider immer häufiger beobachten kann: politisch anschlussfähige Narrative werden durch Studien gestützt, deren methodische Grundlage bei genauer Betrachtung erstaunlich fragil ist.

Eine solche Kritik ist regelmäßig kein Randphänomen, sondern gehört zum Kern der wissenschaftlichen Methode. Wissenschaft lebt davon, dass Aussagen überprüfbar, reproduzierbar und methodisch nachvollziehbar sind. Wenn Begriffe unscharf definiert werden, Stichproben nicht repräsentativ sind oder Aktivismus und Forschung ineinander übergehen, verliert eine Studie ihre wichtigste Währung: Glaubwürdigkeit.

Genau hier setzt Webers Analyse an. Sein Punkt ist nicht, dass es keine problematischen Formen von Kommunikation im Internet gäbe. Der entscheidende Punkt ist vielmehr ein anderer: Wenn bereits Kritik, Ironie oder scharfe politische Auseinandersetzung unter den Sammelbegriff „digitale Gewalt“ subsumiert werden, entsteht zwangsläufig ein statistisches Bild, das dramatischer wirkt, als es methodisch gerechtfertigt ist.

In der Forschung nennt man das ein Problem der Operationalisierung. Ein Begriff ist nur dann wissenschaftlich brauchbar, wenn klar definiert ist, was genau gemessen wird. Wird diese Grenze verwischt, verwandelt sich eine Studie schnell von einer empirischen Untersuchung in ein politisches Instrument.

Hinzu kommt ein zweites Problem, das Weber ebenfalls anspricht: die Selbstselektion von Teilnehmern bei Online-Umfragen. Wenn sich Menschen freiwillig an einer Befragung beteiligen, nehmen naturgemäß eher diejenigen teil, die bereits negative Erfahrungen gemacht haben. Das führt zu systematischen Verzerrungen der Datenbasis. In der empirischen Sozialforschung ist dieses Problem seit Jahrzehnten bekannt.

Der dritte Punkt betrifft die Rolle der Medien. Studien mit politisch anschlussfähigen Ergebnissen werden häufig sehr schnell verbreitet, während eine kritische Auseinandersetzung mit der Methodik kaum stattfindet. Für Journalisten ist die Versuchung groß, eine zugespitzte Zahl oder Schlagzeile zu übernehmen. Für die wissenschaftliche Qualität ist das jedoch gefährlich, weil sich dadurch schwache Studien sehr schnell in scheinbar gesicherte Erkenntnisse verwandeln.

Gerade deshalb ist die Arbeit von Kritikern wie Stefan Weber wichtig. Wissenschaftliche Qualität entsteht nicht durch moralische Intentionen, sondern durch methodische Strenge. Wenn Studien politisch oder medial Wirkung entfalten sollen, müssen sie besonders hohen Standards genügen.

Die eigentliche Pointe von Webers Beitrag liegt deshalb in einer einfachen, aber oft vergessenen Einsicht:

Eine gesellschaftlich relevante Fragestellung rechtfertigt keine methodisch schwache Forschung. Im Gegenteil – je größer die politische Wirkung einer Studie ist, desto höher müssen die Anforderungen an ihre wissenschaftliche Solidität sein.

In diesem Sinne ist die Kritik keine Ablehnung des Themas, sondern ein Plädoyer für etwas sehr Grundlegendes:

für saubere Methodik, transparente Datengrundlagen und eine Wissenschaft, die ihre eigenen Standards ernst nimmt.

Denn ohne diese Standards verwandelt sich Forschung schnell in etwas anderes – in gut gemeinte, aber letztlich wenig belastbare Argumentationshilfe im politischen Diskurs. Und genau darauf macht Weber aufmerksam.